Menschen bevorzugen Inhalte, Kunst und Kultur von Menschen. Wie aber setzen wir uns zukünftig von KI-Produkten ab, wenn diese zunehmend authentisch erscheinen?

Lässt sich ein Laberpodcast per KI komplett simulieren – und würde man hören wollen, wie zwei künstliche Stimmen miteinander herumblödeln? Ein Forschungsprojekt der Universität Tübingen hat genau das ausprobiert. Das Ergebnis zeigt, dass KI inzwischen schon recht gut, wenn auch lange nicht perfekt, Unterhaltung reproduzieren kann. Aber unabhängig davon, wie authentisch die Produktion auch erscheinen mag: Das Publikum will offensichtlich im Bewusstsein zuhören, dass sich echte Menschen unterhalten. Das zumindest lässt sich aus ersten Rückmeldungen der Hörer:innen vermuten und aus weiteren Studien ableiten.

Laber-Podcast im wissenschaftlichen Versuch

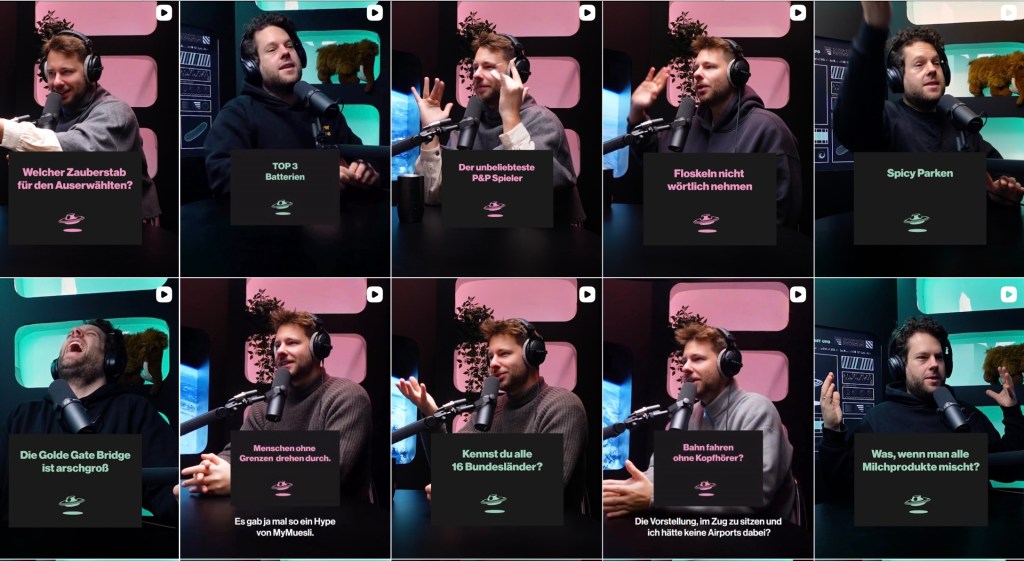

Die Idee hatten die Hosts (Stefan Titze und Florentin Will) von „Das Podcast-Ufo“ selbst in die Welt gesetzt: Könnte eine KI eine ganze Folge ihres erfolgreichen Podcasts produzieren, der von Improvisation, spontanen Gesprächsdynamiken und den Persönlichkeiten der beiden Gesprächspartner lebt? Würden ihre Hörer:innen erkennen, dass es nur eine simulierte Episode war, und falls ja: Wie würden sie reagieren?

Forschende des RHET AI Centers der Universität Tübingen übernahmen und produzierten auf Basis von akribischer Analyse der bislang erschienenen Folgen, mit Hilfe von diversen KI-Tools und in sehr enger Abstimmung mit den Hosts eine eigene Episode. „Das Podcast-Ufo“ ist einer der erfolgreichsten Podcasts im Genre der Comedy, mit treuer Community und über 500 Folgen – viel Material also, mit dem die KI trainiert werden konnte.

Überraschend authentisch

Das Ergebnis war für die beiden Macher überraschend nah an ihren eigenen Produktionen, die Stimmen erschienen täuschend echt. Vor allem aber in der Gesprächsführung war die KI als solche erkennbar. Wer sich im Detail für die spannende Vorgehensweise der Forschenden interessiert, erfährt das in der „Aufklärungsfolge“, die einen Tag nach der zunächst ohne KI-Label simulierten Episode veröffentlicht worden ist. In der Podcast-Broschüre (Seite 58-69) der Hamburg Open Online University (HOOU) beschreiben die beteiligten Wissenschaftler:innen das Projekt ausführlich; auf ihrer Website gibt es eine ausführliche Dokumentation.

Wo bleibt die Beziehung?

Interessant ist, was Titze und Will über die ersten Reaktionen ihrer Community berichten. Einzelne seien grundsätzlich sehr kritisch gegenüber KI eingestellt. Sie hätten die Folge deshalb entsprechend rundherum abgelehnt, als sie erkannten, wie sie entstanden war. Die Reaktionen der Hörer:innen gehen gerade erst ein, ihre Auswertung wird Teil der Studie sein.

Ich halte die ersten Reaktionen für bezeichnend: Es ist bekannt, dass Hörer:innen zu den Hosts ihrer Lieblingspodcasts parasoziale Beziehungen aufbauen. Und die werden natürlich gestört, wenn der Mensch am Mikro plötzlich nicht mehr vorstellbar ist, weil bewusst wird, dass das, was zu hören ist, KI-generiert ist.

Die ablehnende Reaktion gegenüber künstlich erzeugter Kunst, Musik oder auch Literatur hat aber noch weitere Gründe – das zeigen andere Studien. Untersuchungen zur Wahrnehmung von Kunst belegen zum Beispiel, dass Menschen einzelne Werke im Blindtest mögen, wenn sie nur das sichtbare Ergebnis bewerten. („Bias against AI art can enhance perceptions of human creativity, nature 2023“) Das ist nicht erstaunlich, da die KI-Werke oftmals auf „Gefallen“ optimiert sind. Menschen werten dasselbe Bild jedoch ab, sobald sie wissen, dass sich hier niemand die künstlerische Mühe gemacht hat, es zu erstellen. Offensichtlich ist es Teil des Erlebens von Qualität, dass man sich den Prozess und die Anstrengungen der Entstehung eines Kunstwerks vorstellen kann.

Abgrenzung durch Kennzeichnung des Faktors Mensch

Wenn diese Faktoren für die Wertschätzung des Publikums eine Rolle spielen, so würde es sich lohnen, sie sichtbar zu machen. Auch für den Schutz vor Desinformation brauchen wir zukünftig Hinweise, die uns nachvollziehen lassen, wie ein Text, ein Bild oder ein Musikstück entstanden sind.

Diese Hinweise ließen sich auf zwei Ebenen integrieren:

- Technik: Inhalte werden zukünftig einen digitalen Stempel tragen können. Ein erster Standard ist dafür bereits entwickelt – wer sich im Detail dafür interessiert, kann unter dem Stichwort „C2PA“ mehr dazu finden. Der Stempel enthält Informationen, unter anderem darüber, wer den Inhalt erstellt hat, wann/wo er entstanden ist, welche Programme und Tools benutzt worden sind und welche Bearbeitungsschritte stattfanden – und eben auch, ob und wie KI beteiligt war. Es wird aus meiner Sicht zunehmend Bestandteil der verantwortungsvollen Kommunikation werden, mit Kennzeichnungen dieser Art zu arbeiten, um die Orientierung zu ermöglichen, die unmarkierte KI-Inhalte nicht leisten.

- Inhaltliche Gestaltung: Wer beweisen möchte, dass eigene Inhalte „menschengemacht“ sind, macht den Prozess ihrer Entstehung sichtbar – im Making-of zum Beispiel, durch Fotos und das Nacherzählen des Entstehungsprozesses.

Der menschliche Produktionsprozess als Gewinn

Dieser inhaltliche Aspekt liefert mehr als nur einen Beweis der Authentizität. Ist der Prozess der Entstehung in einer Information, einem Kunstwerk oder anderen Produkten eingeschrieben, erweitert dies auch den Erkenntnisgewinn.

Während die KI als Blackbox wenig über die Entstehung ihrer Produkte offenbaren kann und vorrangig Ergebnisse liefert, können Menschen rekonstruieren, in welchen Schritten es dazu gekommen ist. Das kann als Information nachhaltiger sein als das Ergebnis selbst.

Und beim Schreiben fällt mir auf: Diese Idee ist nicht neu. Ich erinnere mich an ein Experiment, das ich vor fast dreizehn (sic!) Jahren hier (vor der Tagung) und hier (danach) im Blog beschrieben habe. Dirk von Gehlen hatte damals sein Buch „Eine neue Version ist verfügbar“ in enger Begleitung durch seine Crowdfunding-Community entstehen lassen. Eine seiner zentralen Thesen damals:

„An die Stelle des Endproduktes tritt das Prozesshafte seiner Entstehung. Man erfährt mehr über ein Kunst- oder Kulturprodukt, wenn man die verschiedenen Versionen und den Entstehungsprozess nachvollzieht. Die Digitalisierung ermöglicht dies.“ (eigene Zusammenfassung, inkladde, 10. Mai 2013)

Mensch und KI – was macht den Unterschied aus?

Letztlich führen all diese Fragen zur Konkurrenz zwischen Mensch und KI, die uns derzeit in so vielen Diskussionen begegnet. Wir vernachlässigen dabei, dass die Grenzen gar nicht so eindeutig sind, wie es in den Debatten häufig erscheint. Offensichtlich haben wir aber ein starkes Bedürfnis, uns abzuheben, als Menschen sichtbar zu bleiben.

Ich denke auch, dass das richtig ist. Gerade weil KI-Tools zunehmend Einzug in unseren Alltag finden, sollten wir uns umso mehr bewusst machen, was uns als Menschen von der KI unterscheidet – und genau diesen Anteil zukünftig betonen.

In meinem aktuellen Newsletter „Gute Frage!“ habe ich diese Überlegung an der Frage „Hat KI Geschmack?“ durchgespielt.

Und fast parallel hat André Cramer sich intensiv mit der menschlichen Rezeption auseinandergesetzt und über die Bedeutung menschlicher Kreativität und Urteilskraft in Zeiten von KI geschrieben. Er warnt:

„Die Maschine kann Muster fortsetzen, beschleunigen, kombinieren. Aber sie kann – und darf – nicht die kulturelle Instanz sein, die festlegt, was bedeutsam, stimmig, verantwortlich oder erzählenswert ist. Sobald diese normative Vorrangstellung von und durch uns Menschen aufgegeben wird, wird Technologie zum Taktgeber dessen, wie gesprochen, erzählt und visualisiert wird. Wollen wir das?“

André Cramer, Newsletter #Dranbleiben, Folge 184, 15. März 2026

Ich bin eigentlich sehr zuversichtlich, dass unser Bedürfnis, Menschliches und von Menschen Gemachtes zu erleben, groß genug ist, so dass genau das nicht passieren wird. Viele haben schon jetzt den oftmals berechtigten Eindruck, dass KI ihnen höchstens Mittelmaß liefert. Ob das so bleiben wird, ob es vielleicht gerade eine Eigenschaft von KI ist, ist eine andere interessante Frage.

Auf die Ergebnisse des Versuchs in Tübingen bin ich gespannt – vor allem, was die Reaktionen der Hörenden betrifft. Die Forscher:innen freuen sich übrigens über Feedback – auch von jenseits der Community.

Weitere interessante Gedanken zum Thema sind im Podcast „Whoa, Vol. 2“ im Gespräch mit dem Autor Oliver Burkeman zu hören: „Why I Don’t Use AI to Write“. Er warnt davor, Texte im ganz frühen oder auch späten Stadium mit einer KI bearbeiten zu lassen, unter anderem, weil sie dann ihre persönliche Note verlören und auch an Bedeutung einbüßten.

Ich teile seine Einschätzung. So ist dieser Text hier in mehreren Phasen entstanden, ich habe ihn einmal heruntergeschrieben, war zunächst begeistert, am nächsten Morgen dann nicht mehr so sehr, habe ihn noch einmal umgeschrieben, gekürzt, erweitert, zwischendurch einmal per KI auf Rechtschreibung geprüft, ein wenig ergänzt und dann veröffentlicht. Und ich freue mich, wie immer, über Meinungen zum Thema.